DeepSeek R1:

Der Aufstieg einer chinesischen Open-Source-KI

Aufzeichnung des DeepSeek Webinars vom 13.02.2025

Was ist DeepSeek R1?

DeepSeekR1 ist ein neue Open-Source-KI , die derzeit viel Aufmerksamkeit bekommt. Entwickelt von einem chinesischen Startup, wird es als ernstzunehmende Konkurrenz zu GPT-4 und anderen kommerziellen Großmodellen diskutiert. Das Besondere an DeepSeekR1 ist nicht nur seine Leistungsstärke, sondern vor allem der Open-Source-Ansatz und die Möglichkeit zum lokalen Einsatz. Diese Eigenschaften machen das Modell für Forschung, Lehre und Unternehmen besonders interessant.

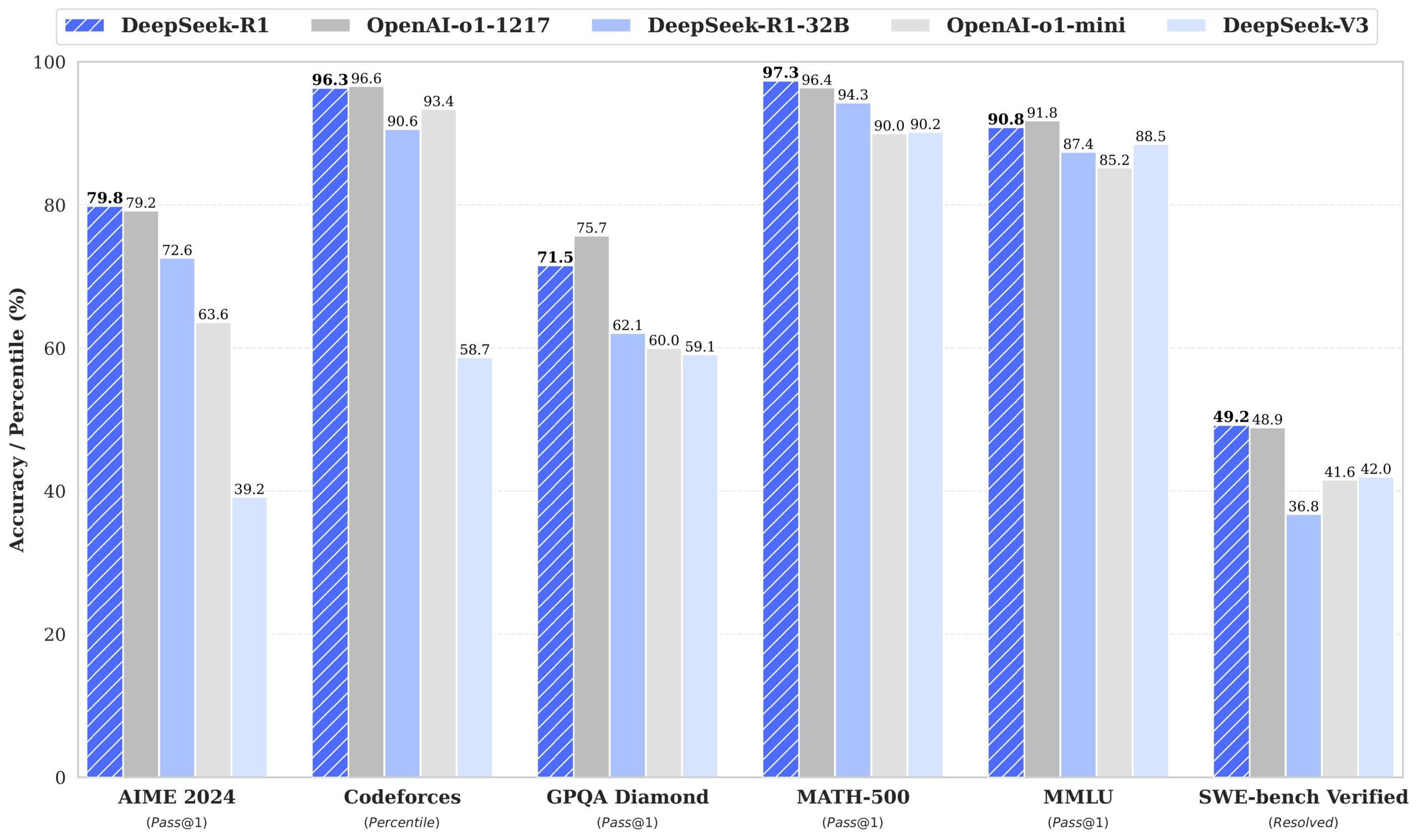

DeepSeek R1 im Benchmark

DeepSeek R1 punktet durch intelligente Modellarchitektur

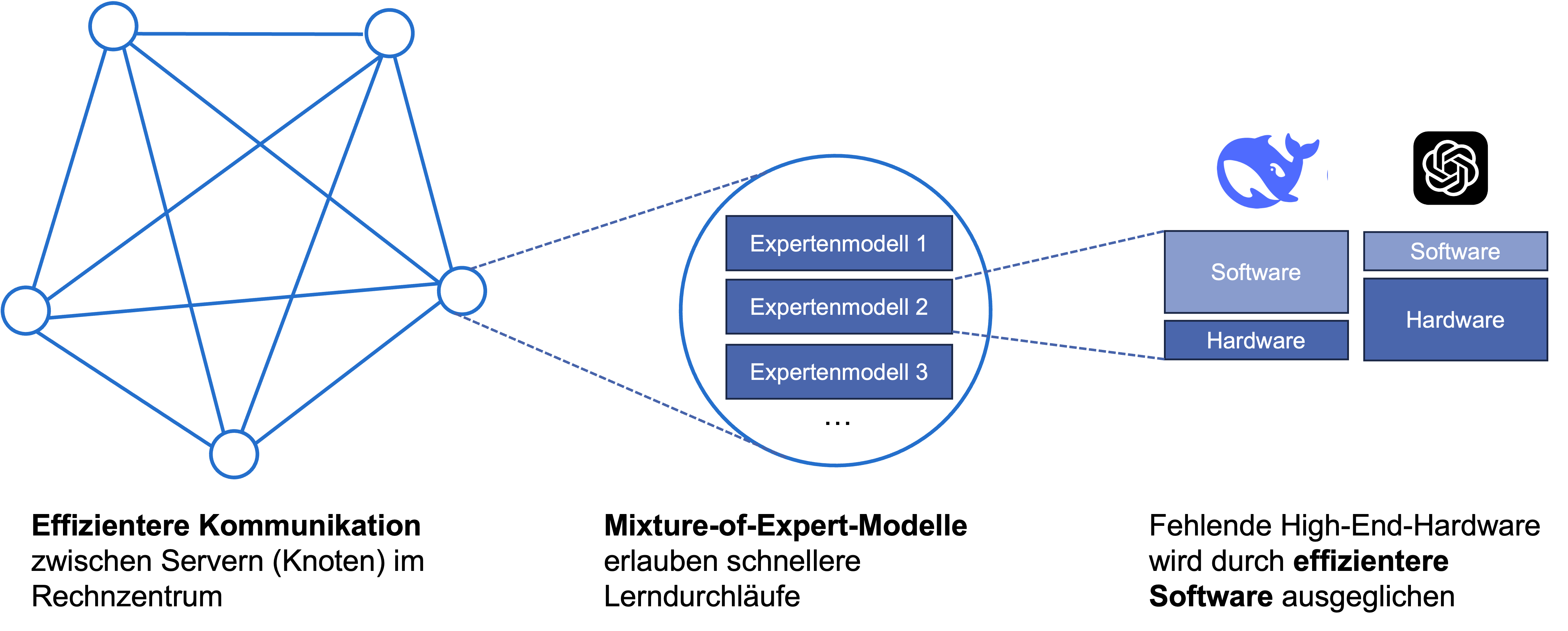

Ein zentraler Innovationspunkt von DeepSeekR1 ist das sogenannte Mixture-of-Experts-Konzept. Statt ein monolithisches Modell permanent vollständig zu aktivieren, setzt DeepSeek R1 auf spezialisierte Teilmodelle, die je nach Aufgabenstellung gezielt angesteuert werden. Dadurch lassen sich Rechenressourcen effizienter nutzen. In der Praxis bedeutet das: Nur die für eine bestimmte Aufgabe relevante Teil-KI wird geladen und verwendet.

Zusätzlich wurde die für das Training eingesetzte Software auf Low-Level-Ebene optimiert. Standardbibliotheken wurden angepasst, Speicherverwaltung verbessert und Kommunikationswege zwischen Recheneinheiten verkürzt. Dadurch kann das Modell trotz vergleichsweise einfacher Hardwareumgebung mit kommerziellen Großmodellen konkurrieren.

Der Lernprozess von DeepSeek

Innovative, sichere Open-Source-KI im Lokalbetrieb

Für Europa öffnet sich damit ein neues Innovationsfenster: Wenn leistungsstarke Sprachmodelle über Open-Source-Lizenzen verfügbar sind, lassen sich eigene Anwendungen entwickeln, ohne auf proprietäre US-Lösungen zurückgreifen zu müssen. Gerade in Forschungseinrichtungen und mittelständischen Unternehmen bietet dies neue Möglichkeiten, eigene KI-Kompetenzen aufzubauen. Dies ist vor allem im europäischen Kontext relevant, wo Datenschutz und Datenhoheit zentrale Themen darstellen. Anders als bei Cloud-basierten Diensten wie ChatGPT besteht hier die Option, das Modell lokal im eigenen Rechenzentrum oder auf dedizierter Hardware zu hosten.

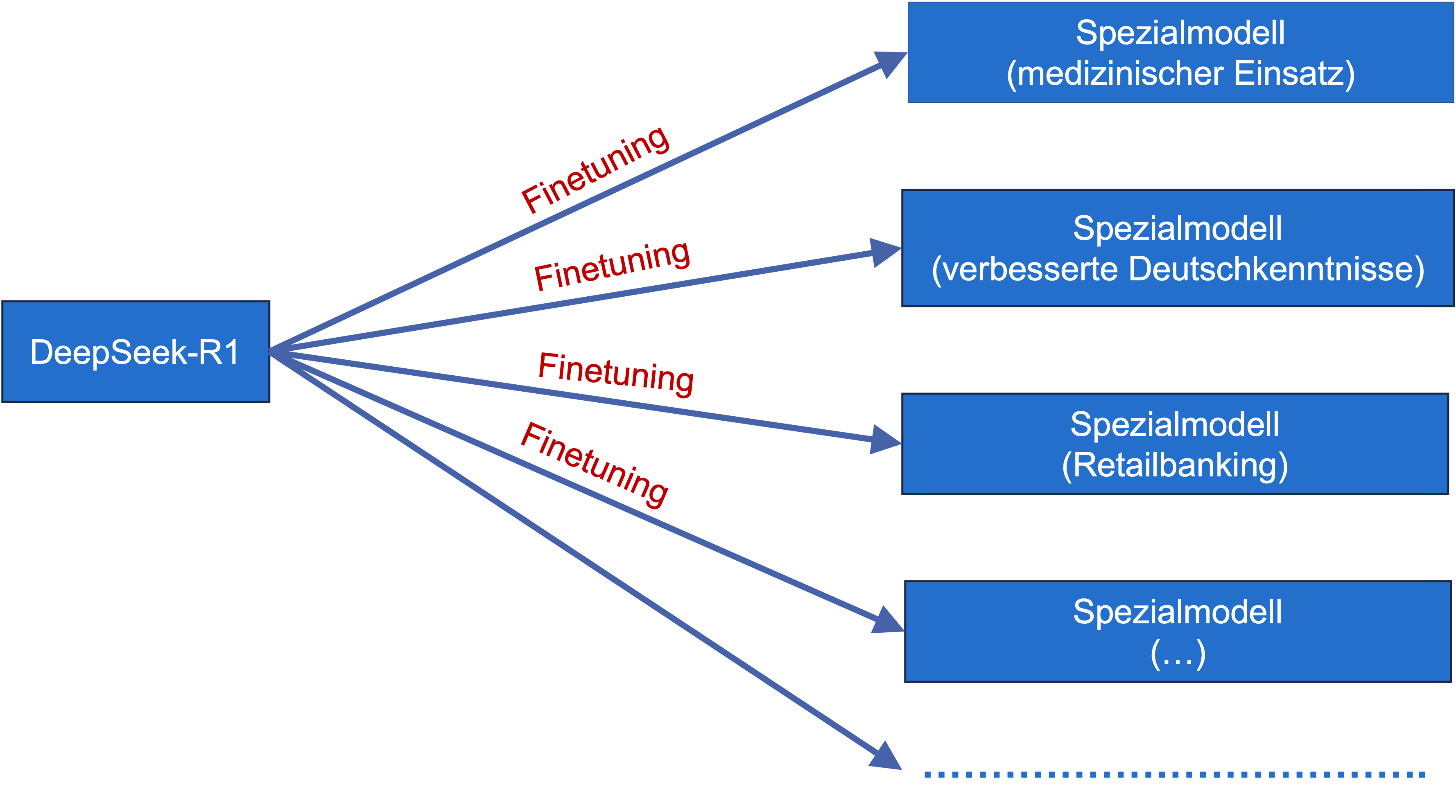

Für viele Organisationen bietet dies eine neue Grundlage für die Entwicklung sicherer, DSGVO-konformer KI-Anwendungen in denen sensible Daten verarbeitet werden konnen, ohne sie an externe Anbieter zu übermitteln. Darüber hinaus ist durch gezieltes Fine-Tuning eine thematische Spezialisierung möglich. Ob medizinische Sprache, juristische Texte oder technisches Fachvokabular – DeepSeekR1 kann auf spezifische Bedarfe zugeschnitten werden. Diese Flexibilität unterstreicht das Potenzial, das Open Source KI-Modell selbst zu betreiben und auf konkrete Anwendungsfälle auszurichten

DeepSeek als Ausgangspunkt für lokal betriebene Spezialmodelle

China trotzt Exportbeschränkungen und verschiebt globales Machtgefüge

Die Entwicklung von DeepSeek R1 ist nicht nur technisch, sondern auch geopolitisch bemerkenswert. Die USA kontrollieren viele der leistungsfähigsten KI-Chips über Exportbeschränkungen. Dass ein chinesisches Unternehmen unter diesen Bedingungen ein konkurrenzfähiges Modell entwickeln konnte, stellt bisherige Annahmen über die Abhängigkeit von High-End-Hardware in Frage. DeepSeek demonstriert, dass es möglich ist, auch mit begrenztem Zugang zu US-Technologie Modelle auf dem neuesten Stand der Technik zu entwickeln. Dies könnte den technologischen Wettbewerb zwischen China und den USA weiter verschärfen. Besonders bemerkenswert ist, dass DeepSeek nicht nur im chinesischen Markt, sondern auch international Beachtung findet – ein Hinweis darauf, dass sich der Fokus globaler KI-Forschung verschiebt. Während bislang US-amerikanische Unternehmen wie OpenAI, Google oder Anthropic als führend galten, tritt nun ein chinesisches Unternehmen mit einem leistungsfähigen Open-Source-Modell in den Vordergrund.

Diese Entwicklung hat auch strategische Implikationen: Wenn China in der Lage ist, eigene leistungsfähige KI-Systeme unabhängig von westlicher Hardware zu entwickeln, könnte dies langfristig die Wirksamkeit von Exportkontrollen untergraben. Gleichzeitig zeigt DeepSeek wie stark Open Source Modelle geworden sind und wie sehr sich der internationale Diskurs über KI in den kommenden Jahren verändern könnte.

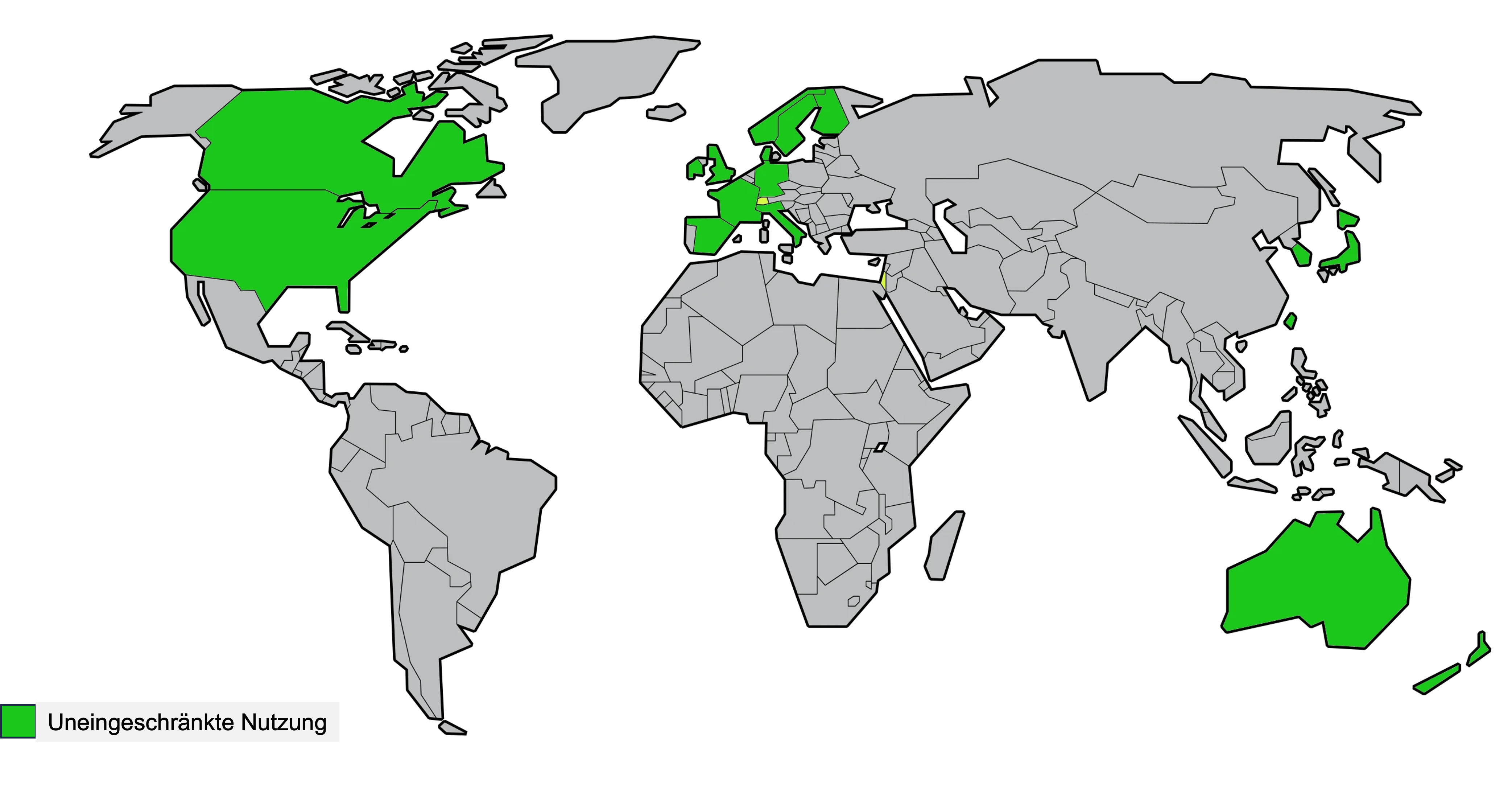

Verfügbarkeit von KI-Chips weltweit

Kritik an DeepSeek: Fehlende Transparenz und Zweifel an Trainingsmethoden

Trotz vieler positiver Aspekte gibt es berechtigte Kritikpunkte. Die von DeepSeek veröffentlichten Kostenangaben – rund sechs Millionen US-Dollar für Training und Entwicklung – erscheinen unrealistisch niedrig. Es ist davon auszugehen, dass zusätzliche Investitionen, möglicherweise durch staatliche Stellen, geleistet wurden. Ein weiterer Kritikpunkt betrifft die Trainingsmethode: Es gibt Hinweise darauf, dass DeepSeek R1 bei der Wissensgewinnung auf Antworten von ChatGPT zurückgegriffen hat. Dieses Vorgehen wird als „Knowledge Distillation“ bezeichnet und ist aus urheberrechtlicher Sicht umstritten. Zudem zeigt das Modell in Bezug auf sensible politische Fragen eine erkennbare Zensur. Fragen zu geopolitisch kritischen Themen wie Taiwan werden ausgewichen beantwortet. Dies unterstreicht, dass ein verantwortungsvoller Einsatz nur möglich ist, wenn das Open Source KI-Modell selbst betrieben und kontrolliert wird.

Eine Open-Source-KI mit enormen Potenzial

DeepSeek R1 steht für einen Paradigmenwechsel in der KI-Entwicklung. Durch Open-Source-Zugänglichkeit, effiziente Architektur und Möglichkeit zum lokalen Betrieb bietet das Modell ein hohes Maß an Flexibilität für Unternehmen, die Innovationen datenschutzkonform vorantreiben.

Gerade in akademischen Kontexten ermöglicht DeepSeekR1 das Testen eigener Trainingsstrategien, die Entwicklung domänenspezifischer Modelle und die Integration in lokale Systeme. Auch für kleine Unternehmen und Startups ist es eine attraktive Option, da es leistungsstarke KI-Technologie ohne Abhängigkeit von US-Anbietern zugänglich macht.